Kafka 实现高效数据读写与事务保障的在线数据处理与交易系统核心

在现代互联网架构中,尤其是在线数据处理(OLAP)与交易处理(OLTP)业务场景下,对数据的实时性、吞吐量、可靠性和一致性提出了前所未有的要求。Apache Kafka作为一款分布式的、高吞吐量的发布-订阅消息系统,凭借其独特的设计理念,已成为构建此类系统的核心基础设施。其高效读写数据的能力以及日益完善的事务支持,为处理海量实时数据流和关键业务交易提供了坚实的技术保障。

一、 高效读写数据的核心机制

Kafka实现高效数据读写,源于其精心设计的架构与数据管理策略。

- 顺序I/O与零拷贝技术:

- 顺序读写:Kafka将消息持久化到磁盘日志文件中,并且采用追加写入(Append-Only)的方式。这种顺序I/O操作相比随机I/O,速度可以高出几个数量级,极大地提升了写入性能。

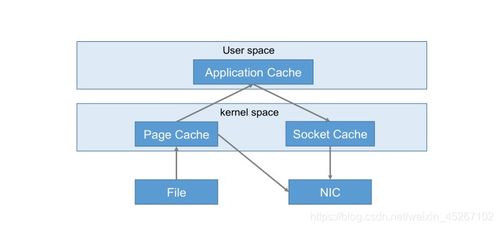

- 零拷贝(Zero-Copy):在消费者读取数据时,Kafka利用操作系统提供的

sendfile等系统调用,将磁盘文件的数据直接通过网络发送,避免了在内核空间和用户空间之间的多次数据拷贝,显著降低了CPU开销和延迟,提升了读取效率。

- 分区与并行处理:

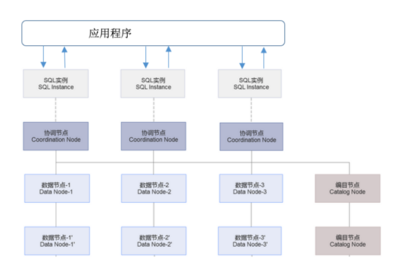

- Kafka的Topic被划分为多个分区(Partition),每个分区是一个有序、不可变的消息序列。生产者可以将消息并行地写入不同分区,消费者也可以从多个分区并行消费。这种分区机制天然支持水平扩展,通过增加分区和消费者实例,可以线性地提升系统的吞吐量。

- 批处理与压缩:

- 生产者客户端支持将多条消息批量发送,减少了网络请求的次数,提高了网络利用率。

- Kafka支持对消息批次进行压缩(如gzip, snappy, lz4, zstd),在传输和存储过程中减少数据体积,进一步节省了网络带宽和磁盘I/O。

- 高效的存储格式:

- Kafka的消息以紧凑的二进制格式存储,并且一个分区在磁盘上对应一组顺序的日志段文件(Segment)。这种设计使得索引和查找非常高效,也便于进行日志清理和老化。

二、 事务支持与数据一致性保障

对于在线交易处理(OLTP)这类需要强一致性保证的业务,Kafka的事务功能至关重要。它确保了在跨多个分区和消费者的场景下,消息处理的“精确一次”(Exactly-Once)语义。

- 事务的核心概念:

- 幂等性生产者:确保生产者发送到同一分区的消息具有唯一序列号,Broker端可以据此去重,避免因生产者重试导致的消息重复。这是实现事务的基础。

- 跨分区原子写入:Kafka事务允许生产者将一批消息以原子方式发送到多个分区。要么全部成功,要么全部失败,不会出现部分写入的情况。这对于需要更新多个状态或实体的业务操作(如“扣减库存”与“生成订单”)至关重要。

- 读-处理-写模式:这是Kafka事务最典型的应用场景。一个消费者事务可以原子性地完成“从输入Topic消费消息”、“执行业务处理逻辑”、“将结果写入输出Topic”这一系列操作。

- 事务的工作流程:

- 初始化:生产者通过

initTransactions()API初始化事务。

- 开始事务:调用

beginTransaction()开始一个新事务。

- 生产消息:在事务上下文中发送消息。这些消息会被标记为“未提交”,对其他消费者不可见。

- 提交或中止:业务逻辑成功后,调用

commitTransaction()提交事务,所有未提交的消息将对消费者可见;若失败则调用abortTransaction()中止事务,所有未提交的消息将被丢弃。

- 事务协调者与日志:

- Kafka集群中会选举出一个事务协调者(Transaction Coordinator)来管理事务的生命周期。

- 事务的状态(如“进行中”、“已提交”、“已中止”)会作为一个特殊的消息写入一个内部的

<em>_transaction</em>stateTopic中,以实现持久化和故障恢复。

三、 在在线数据处理与交易处理中的应用

结合高效读写与事务能力,Kafka在OLAP与OLTP混合场景中大放异彩:

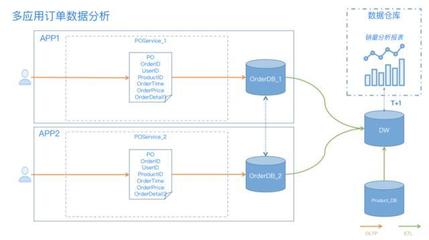

- 实时数据管道:作为数据总线,高效承接来自前端应用、数据库日志(CDC)、IoT设备的海量数据,并将其实时分发给下游的流处理引擎(如Flink、Spark Streaming)、数据仓库或分析系统,支撑实时监控、风险控制、个性化推荐等OLAP场景。

- 事件驱动微服务架构:服务间通过Kafka Topic进行异步通信。事务保证了核心业务操作(如订单创建、支付)相关的事件能够可靠、一致地在不同服务间传递,解耦服务的同时确保了系统最终一致性,是构建现代OLTP系统的重要模式。

- 交易日志与审计:所有关键的业务状态变更都可以作为不可变的事件(Event)发布到Kafka。这既提供了一份权威的审计日志,也为实现事件溯源(Event Sourcing)和CQRS架构提供了可能。

###

Apache Kafka通过其顺序I/O、分区并行、零拷贝等机制,实现了卓越的数据读写性能,满足了在线数据处理对高吞吐、低延迟的苛刻要求。其强大的事务机制,为在线交易处理业务提供了关键的数据一致性与可靠性保障。正是这两种能力的结合,使得Kafka超越了传统消息队列的范畴,成为构建实时、可靠、可扩展的现代数据驱动应用的核心基石。在设计和实施相关系统时,深入理解并合理运用Kafka的高效读写与事务特性,是确保系统成功的关键。

最新产品

深圳办理医疗器械备案与稳定可靠的在线数据处理与交易处理业务指南

核心业务“瘦身”进行时 手把手教你构建海量数据实时处理架构

中台崛起的本质 一场“去ERP化”的数据与交易处理革命

无人机与数据处理技术 通用航空在疫情防控中的关键角色与数据洞察

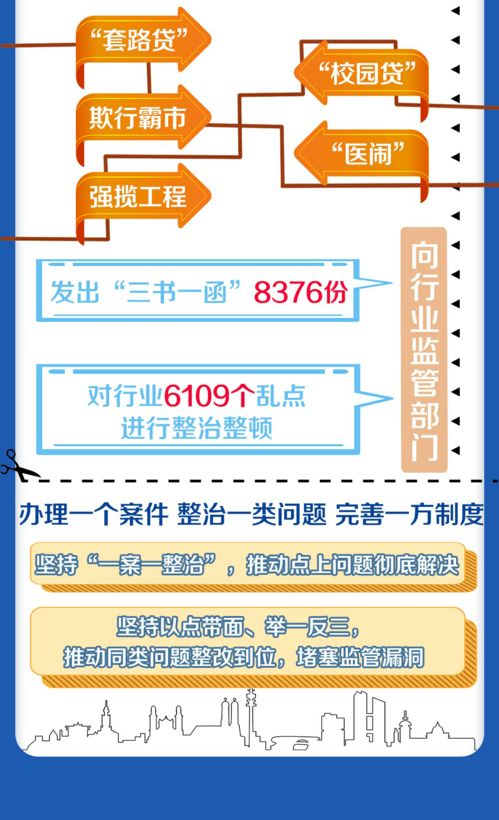

山西扫黑除恶专项斗争成果展 在线数据处理与交易处理业务赋能精准打击

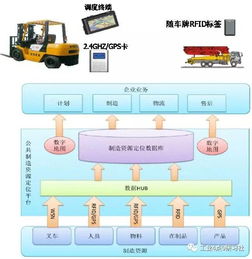

数据驱动,智造未来 探索18号智能工厂的在线数据处理与交易处理业务

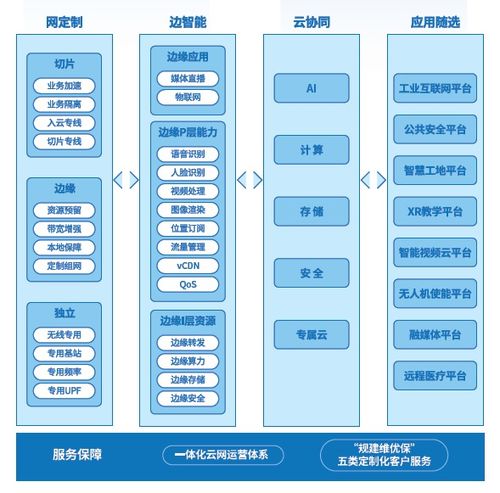

中国电信数据专线业务与在线数据处理及交易处理业务的深度解析

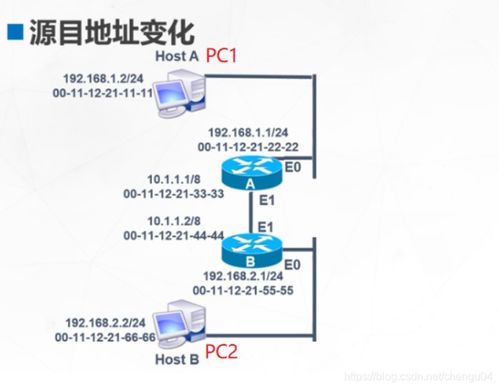

路由器工作原理与华为静态路由配置详解

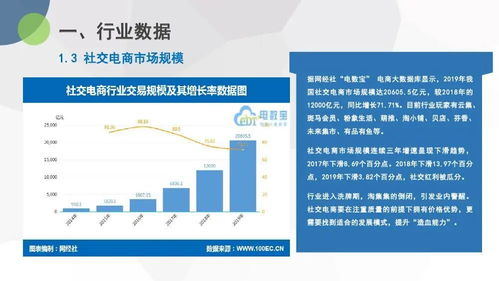

2019年中国社交电商市场数据报告 在线数据处理与交易处理业务的深度解析

数据驱动决策 如何通过在线数据处理与交易分析挖掘业务增长机会